Essere umani

L'intelligenza artificiale (AI) sta penetrando nella nostra società. L'IA può scrivere messaggi di testo e creare immagini. Ha molte facce: a volte è una minaccia, a volte un arricchimento, a volte un semplice espediente. La domanda è cosa rende umani noi esseri umani.

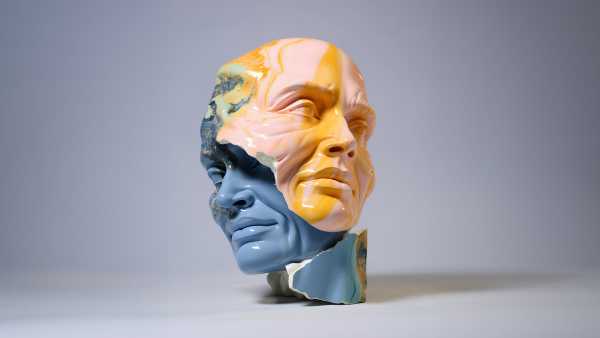

La serie di immagini sul tema "Cosa tiene insieme il mondo" in questo numero di Globe è stata creata da un'intelligenza artificiale (AI). Il software Midjourney ha trasformato le nostre parole chiave in immagini, con risultati sorprendenti. Le sculture mostrate non esistono nella realtà. Il programma ha selezionato i pixel in modo tale da creare l'impressione di un oggetto tridimensionale. Come si addice a una cosiddetta IA generativa, ha creato qualcosa che non esisterebbe senza di essa.

Altri programmi sono in grado di scrivere testi propri o di entrare in dialogo con le persone come chatbot. Il chatbot più noto è attualmente chatGPT. Il programma dell'azienda statunitense OpenAI utilizza un'intelligenza artificiale per comunicare tramite messaggi di testo. La sua ascesa è stata fulminea. In due mesi il programma ha superato la barriera dei 100 milioni di utenti. Facebook ha impiegato più di quattro anni. Il telefono analogico 75 anni. Google vuole seguire l'esempio con il suo nuovo chatbot Bard.

Anche le critiche alla chatGPT non si sono fatte attendere. Ad esempio, ci sono controversie legali sulle violazioni del copyright in relazione ai dati utilizzati per addestrare il modello linguistico sottostante. Un altro punto critico riguarda l'accuratezza delle affermazioni se non è chiaro come il chatbot vi arrivi e se non vengono fornite fonti.

La serie di immagini è stata creata in collaborazione con l'agenzia Sir Mary. Il software di intelligenza artificiale Midjourney ha generato sculture sulla base di suggerimenti in inglese.

Prompt: scultura di un'enorme biodiversità su un piedistallo, sculture iperrealistiche, colori pastello

Prompt: scultura di un'enorme biodiversità su un piedistallo, sculture iperrealistiche, colori pastello Prompt: scultura della curvatura dell'orologio dello spazio-tempo su un piedistallo, sculture iperrealistiche, colori pastello

Prompt: scultura della curvatura dell'orologio dello spazio-tempo su un piedistallo, sculture iperrealistiche, colori pastello Prompt: scultura con due facce su un piedistallo di marmo, sculture iperrealistiche, colori pastello

Prompt: scultura con due facce su un piedistallo di marmo, sculture iperrealistiche, colori pastello Prompt: scultura di una mela, sculture iperrealistiche, colori pastello

Prompt: scultura di una mela, sculture iperrealistiche, colori pastello Prompt: scultura di una testa-computer-chip su un piedistallo di marmo, sculture iperrealistiche, colori pastello

Prompt: scultura di una testa-computer-chip su un piedistallo di marmo, sculture iperrealistiche, colori pastello

La questione della responsabilità

Anche l'ETH Gudela Grote si occupa di questo tema. Per lei, psicologa industriale, si tratta di capire quando una nuova tecnologia può essere integrata in modo affidabile in un processo di lavoro. "? fondamentale per l'assicurazione della qualità che un sistema tecnico sia certificato. Ma se non è chiaro come si ottengono i risultati, questo è quasi impossibile", afferma Grote. In definitiva, è una questione di responsabilità quando uomo e macchina lavorano insieme. "Come dipendente, mi interessa sapere di cosa dovrò rispondere alla fine", dice la professoressa. Questo vale non solo per la nascente IA generativa, ma per qualsiasi forma di automazione.

Per il professore di informatica Thomas Hofmann, la velocità con cui si sta sviluppando il campo dell'IA generativa è impressionante. "Ma il valore aggiunto è probabilmente ancora maggiore in altre forme di automazione", ipotizza Hofmann. Anche per lui l'inaffidabilità è una sfida. Tutte le applicazioni basate sul testo hanno un problema fondamentale: sono tutte basate su modelli linguistici che sono stati addestrati con tutti i tipi di testi, compresa la letteratura di fantasia.

Questo può avere senso quando si tratta di imparare l'ortografia e la grammatica. Ma le storie inventate non aiutano di certo con l'accuratezza dei fatti. "Attualmente i modelli linguistici non hanno alcuna comprensione di ciò che è fattualmente vero o falso", sottolinea Hofmann, il cui campo di ricerca comprende i modelli linguistici.

Volontario o no

Per lo psicologo industriale Grote, al centro c'è un altro aspetto: chi utilizza una nuova tecnologia è volontario come privato o è obbligato a farlo come dipendente? Nella nostra vita privata, come clienti di aziende tecnologiche, possiamo esercitare un'influenza acquistando e utilizzando la tecnologia - oppure no. Le aziende rispondono a questa esigenza e migliorano le loro offerte. "Come dipendente, sono coinvolto in un processo che non è completamente definito da me", afferma Grote. "Mi trovo di fronte a tecnologie decise dalla mia azienda, di solito senza che i collaboratori abbiano voce in capitolo".

Scientifica 2023

- L'ospedale del futuro: l'intelligenza artificiale al posto delle cure umane?pagina esternaTavola rotonda

- Come l'intelligenza artificiale diventa affidabile.pagina esternaStand espositivo. ETH AI Center, ETH

- Sperimentate robot e IA da vicino.pagina esternaStand espositivo. Laboratorio di robotica soft, l'ETH

Il successo del lavoro con la nuova tecnologia dipende da diversi fattori. "Il fattore chiave è il grado di competenza e di autoefficacia di una persona", afferma Grote. Chi non è particolarmente preparato, ad esempio, è più propenso a temere per il proprio lavoro. Anche la comunicazione da parte dell'azienda sulla direzione tecnologica che sta prendendo il viaggio è fondamentale. "Deve essere chiaro a me, come dipendente, come posso adattarmi e come il mio datore di lavoro mi sosterrà nel farlo", afferma Grote.

Nel migliore dei casi, viene presa in considerazione anche la questione di quali attività consideriamo appaganti. Hofmann fa l'esempio dei modelli linguistici ottimizzati per la programmazione: "Se io impiego dieci ore per scrivere un certo codice senza errori, i modelli riescono a svolgere lo stesso compito in una frazione di secondo", liberando così tempo prezioso per altre attività. "Ma se a qualcuno piace prendersi un giorno libero per programmare, questo sviluppo non lo renderà felice", dice Thomas Hofmann.

Che si tratti di programmazione o di chatGPT, i modelli linguistici stanno penetrando in numerosi settori della nostra società. Per Gudela Grote, il linguaggio è qualcosa di molto speciale. "Il linguaggio parlato è davvero ciò che distingue noi esseri umani", afferma la psicologa. "Il linguaggio è un processo creativo che mette i pensieri in parole", una capacità umana che attualmente viene messa alla prova dai modelli linguistici.

Per Thomas Hofmann, il fatto che un testo sia scritto da un'intelligenza artificiale o da un essere umano fa una grande differenza: "Il linguaggio può sempre essere usato per esprimere sentimenti ed esperienze. Un'IA non ha questa esperienza, anche se il suo testo è ben scritto". Il professore di informatica è stato influenzato anche dai filosofi durante la sua formazione. Si chiede se l'intelligenza e l'essere debbano necessariamente essere legati a un substrato biologico. Si tratta di una domanda sul confine tra intelligenza artificiale ed essere umano.

Le persone

Gudela Grote è professoressa di Psicologia del lavoro e delle organizzazioni presso il Dipartimento di Management, Tecnologia ed Economia dell'ETH di Zurigo.

Thomas Hofmann è professore di Data Analytics presso il Dipartimento di informatica dell'ETH di Zurigo.

"Globe" Ciò che tiene insieme il mondo

Questo testo è stato pubblicato nel numero 23/03 della rivista l'ETH Il globo pubblicato.