?tre humain

L'intelligence artificielle (IA) s'immisce dans notre société. L'IA peut écrire des messages textuels et créer des images. Elle a plusieurs visages : tant?t une menace, tant?t un enrichissement, tant?t un simple gadget. La question est de savoir ce qui fait de nous des êtres humains.

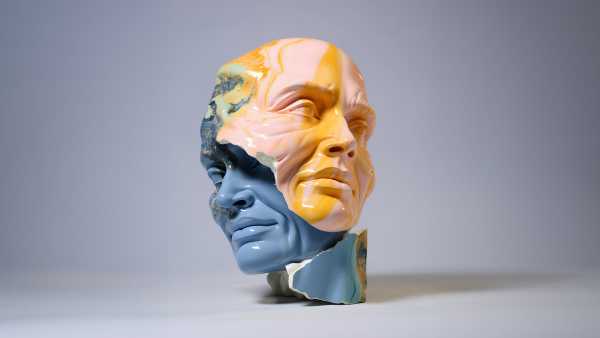

La série d'images sur le thème "Ce qui relie le monde" de ce numéro du Globe a été créée par une intelligence artificielle (IA). Le logiciel Midjourney a transformé nos mots-clés en images - avec un résultat stupéfiant. Les sculptures représentées n'existent pas en réalité. Le programme a choisi les pixels de manière à donner l'impression d'un objet tridimensionnel. Comme il se doit pour une IA dite générative, elle a ainsi créé quelque chose qui n'existerait pas sans elle.

D'autres programmes sont capables d'écrire des textes spécialement pour eux ou d'entrer en dialogue avec des humains en tant que chatbots. Le chatbot le plus connu est actuellement chatGPT. Ce programme de l'entreprise américaine OpenAI utilise une IA pour communiquer au moyen de messages textuels. Son ascension a été fulgurante. En l'espace de deux mois, le programme a franchi le seuil des 100 millions d'utilisateurs. Facebook a mis plus de quatre ans pour y parvenir. Le téléphone analogique 75 ans. Google veut lui embo?ter le pas avec son chatbot Bard nouvellement développé.

Les critiques de chatGPT ne se sont pas non plus fait attendre. Ainsi, il existe des litiges pour violation des droits d'auteur en rapport avec les données avec lesquelles le modèle linguistique sous-jacent a été entra?né. Un autre point critique concerne l'exactitude des déclarations, lorsqu'il est impossible de comprendre comment le chatbot en est arrivé là et qu'aucune source n'est indiquée.

La série d'images a été réalisée en collaboration avec l'agence Sir Mary. Le logiciel d'IA Midjourney a généré des sculptures sur la base de prompts en anglais.

Prompt : sculpture d'une biodiversité massive sur un piédestal, sculptures hyperréalistes, couleurs pastel

Prompt : sculpture d'une biodiversité massive sur un piédestal, sculptures hyperréalistes, couleurs pastel Prompt : sculpture de watch curvature of space-time sur un piédestal, sculptures hyperréalistes, couleurs pastel

Prompt : sculpture de watch curvature of space-time sur un piédestal, sculptures hyperréalistes, couleurs pastel Prompt : sculpture with two faces on a marble pedestal, hyperrealistic sculptures, pastel colours

Prompt : sculpture with two faces on a marble pedestal, hyperrealistic sculptures, pastel colours Prompt : sculpture d'une pomme, sculptures hyperréalistes, couleurs pastel

Prompt : sculpture d'une pomme, sculptures hyperréalistes, couleurs pastel Prompt : sculpture of a head-computer-chip on a marble pedestal, hyperrealistic sculptures, pastel colours

Prompt : sculpture of a head-computer-chip on a marble pedestal, hyperrealistic sculptures, pastel colours

Question de responsabilité

La professeure de l'ETH Gudela Grote se penche également sur cette thématique. Pour elle, en tant que psychologue du travail, la question est de savoir quand une nouvelle technologie peut être intégrée de manière fiable dans un processus de travail. "Pour l'assurance qualité, il est essentiel qu'un système technique soit certifié. Mais si l'on ne peut pas comprendre comment il parvient à ses résultats, c'est presque impossible", explique Grote. En fin de compte, il s'agit de la responsabilité lorsque l'homme et la machine travaillent ensemble. "En tant qu'employée, ce qui m'intéresse, c'est ce dont je dois répondre au final", explique la professeure. Cela ne vaut pas seulement pour l'IA générative en plein essor, mais pour toute forme d'automatisation.

Pour le professeur d'informatique Thomas Hofmann, la vitesse à laquelle le domaine de l'IA générative se développe est impressionnante. "Mais la valeur ajoutée est peut-être encore plus grande pour d'autres formes d'automatisation", suppose Hofmann. Lui aussi considère le manque de fiabilité comme un défi. Toutes les applications basées sur le texte ont un problème fondamental : elles se basent toutes sur des modèles linguistiques qui ont été entra?nés un jour avec toutes sortes de textes, y compris de la littérature fictive.

Cela peut être utile lorsqu'il s'agit d'apprendre l'orthographe et la grammaire. Mais les histoires inventées ne servent certainement pas à la fidélité aux faits. "Les modèles linguistiques n'ont actuellement aucune compréhension de ce qui est vrai ou faux dans les faits", fait remarquer Hofmann, dont le domaine de recherche comprend les modèles linguistiques.

Volontaire ou non

Pour la psychologue du travail Grote, un autre aspect est encore au centre des préoccupations : quelqu'un utilise-t-il une nouvelle technologie volontairement en tant que personne privée ou y est-il obligé en tant que personne employée ? Dans la sphère privée, en tant que clients des entreprises technologiques, nous pouvons exercer une influence en achetant et en utilisant la technologie - ou en ne l'utilisant pas. Les entreprises réagissent à cela et améliorent leurs offres. "En tant qu'employé, je suis impliqué dans un processus qui n'est pas entièrement défini par moi", explique Grote. "Je suis confrontée à des technologies pour lesquelles mon entreprise a opté, le plus souvent sans que les collaborateurs aient leur mot à dire."

Scientifica 2023

- L'h?pital du futur : l'intelligence artificielle plut?t que les soins humains ?site externetable ronde

- Comment l'intelligence artificielle devient digne de confiance.site externeStand d'exposition. AI Center, ETH

- Découvrir de près les robots et l'IA.site externeStand d'exposition. Soft Robotics Lab, ETH

La réussite du travail avec les nouvelles technologies dépend de plusieurs facteurs. "Le degré de compétence et d'efficacité personnelle d'une personne est tout à fait essentiel", sait Grote. Par exemple, une personne qui n'est pas particulièrement bien formée a plut?t tendance à craindre pour son propre emploi. La communication de l'entreprise sur la direction technologique à prendre est également décisive. "En tant qu'employée, il doit être clair pour moi comment je peux m'adapter et comment mon employeur me soutient dans cette démarche", explique Grote.

Dans le meilleur des cas, la question de savoir quelles activités nous considérons comme épanouissantes est également prise en compte. Hofmann donne l'exemple de modèles linguistiques optimisés pour la programmation : "Si l'écriture sans erreur d'un code donné me prend dix heures, les modèles réalisent la même t?che en une fraction de seconde", ce qui permet de consacrer un temps précieux à d'autres activités. "Mais si quelqu'un aime s'isoler une journée pour programmer, cette évolution ne le rend pas heureux", conclut Thomas Hofmann.

Qu'il s'agisse de programmation ou de chatGPT, les modèles linguistiques s'immiscent dans de nombreux domaines de notre société. Pour Gudela Grote, le langage est quelque chose de très spécial. "Le langage parlé est vraiment ce qui nous caractérise en tant qu'êtres humains", explique la psychologue. "Le langage est un processus créatif qui transforme les pensées en mots", une capacité humaine que des modèles linguistiques sont en train de mettre à l'épreuve.

Qu'un texte soit écrit par une IA ou par un être humain, cela fait une grande différence pour Thomas Hofmann : "Le langage permet toujours d'exprimer des sentiments et des expériences. Cette expérience fait défaut à une IA, même si son texte est bien écrit". Le professeur d'informatique a également été influencé par des philosophes durant sa formation. Il pose la question de savoir si l'intelligence et l'être doivent obligatoirement être liés à un substrat biologique. C'est une question sur la frontière entre l'intelligence artificielle et l'être humain.

Vers les personnes

Gudela Grote est professeure de psychologie du travail et de l'organisation au Département management, technologie et économie de l'ETH Zurich.

Thomas Hofmann est professeur d'analyse de données au Département d'informatique de l'ETH Zurich.

"Globe" Ce qui relie le monde

Ce texte a été publié dans le numéro 23/03 du magazine de l'ETH. Globe paru dans la presse.