Des écrans tactiles précis gr?ce à l'IA

Moins de fautes de frappe en touchant un clavier de smartphone : Des informaticiens de l'ETH Zurich ont développé une nouvelle solution d'IA gr?ce à laquelle les écrans tactiles peuvent reconna?tre les touches avec une résolution huit fois supérieure. Il est en outre possible de déduire avec beaucoup plus de précision où les doigts touchent l'écran.

Nous connaissons tous cette situation : lorsqu'on veut taper rapidement un message sur son smartphone, il arrive que l'on se trompe de lettres sur le petit clavier - ou sur d'autres éléments de l'interface utilisateur. Cela ne dépend pas que de nous, car les capteurs tactiles qui détectent la saisie du doigt sur l'écran tactile (touch screen en anglais) n'ont pas beaucoup évolué depuis leur introduction au milieu des années 2000.

Contrairement à leurs capteurs tactiles, les écrans des smartphones et des tablettes atteignent désormais une qualité visuelle sans précédent, qui est encore plus visible à chaque nouvelle génération d'appareils : plus grande fidélité des couleurs, résolution plus élevée, contraste plus net. Alors qu'un téléphone iPhone de dernière génération a par exemple une résolution d'affichage de 2532x1170 pixels, son capteur tactile ne peut reconna?tre que les entrées d'une résolution d'environ 32x15 pixels, soit presque 80 fois moins que la résolution de l'écran : "Et là, nous nous demandons pourquoi nous faisons tant de fautes de frappe sur le petit clavier ? Nous pensons que nous devrions être en mesure de sélectionner des objets par le toucher, au pixel près, mais ce n'est pas le cas", explique Christian Holz, professeur d'informatique à l'ETH, du Sensing, Interaction & Perception Lab (SIPLAB), dans un Interview de la série "Spotlights du site Département d'informatique de l'ETH..

Avec son doctorant Paul Streli, Holz a développé une intelligence artificielle (IA) appelée "CapContact" qui permet de réaliser des écrans tactiles à super-résolution. Ceux-ci sont capables de détecter de manière fiable et bien plus précise que ce qui se fait aujourd'hui la surface de contact où les doigts et la surface de l'écran se touchent réellement. Cette semaine, ils ont présenté leur nouvelle solution d'IA à la page externeCHI 2021, la conférence spécialisée sur les facteurs humains dans les systèmes informatiques, a été présentée.

Reconna?tre l'endroit où les doigts touchent l'écran

Les chercheurs de l'ETH ont développé l'IA pour les écrans tactiles dits capacitifs, c'est-à-dire le type d'écran qui existe dans chacun de nos téléphones portables, tablettes ou ordinateurs portables : Sur ces écrans tactiles, les capteurs reconnaissent la position des doigts par le fait que le champ électrique entre les lignes du capteur change à proximité d'un doigt lorsque celui-ci touche l'écran. Les écrans tactiles utilisent la propriété selon laquelle l'intensité du "toucher" diminue de manière exponentielle à mesure que les doigts s'éloignent. Cependant, ils ne peuvent pas détecter le contact physique réel avec la surface.

La technique sensorielle capacitive n'a jamais été développée pour déduire avec précision l'endroit où se produit effectivement un contact physique sur l'écran, explique Holz : "Elle ne reconna?t que la proximité de nos doigts". Les écrans tactiles des appareils actuels calculent donc la position où l'entrée du doigt se fait à partir de mesures d'approximation à résolution grossière. Les chercheurs ont d?, d'une part, augmenter la faible résolution des capteurs et, d'autre part, trouver comment déduire avec précision la zone de contact respective entre le doigt et la surface de l'écran à partir des mesures capacitives.

Pour ce faire, Streli et Holz utilisent, contrairement à ce qui se fait habituellement, des écrans tactiles comme capteurs d'images. Selon Holz, un écran tactile est à la base une caméra de profondeur à très basse résolution, qui peut regarder à environ huit millimètres. Une caméra de profondeur ne prend pas directement de photos, mais encode la proximité d'objets dans le champ de vision. Avec "CapContact", les chercheurs exploitent cette vision pour estimer en haute résolution la surface de contact physique entre le doigt et l'écran gr?ce à leur méthode d'IA nouvellement développée.

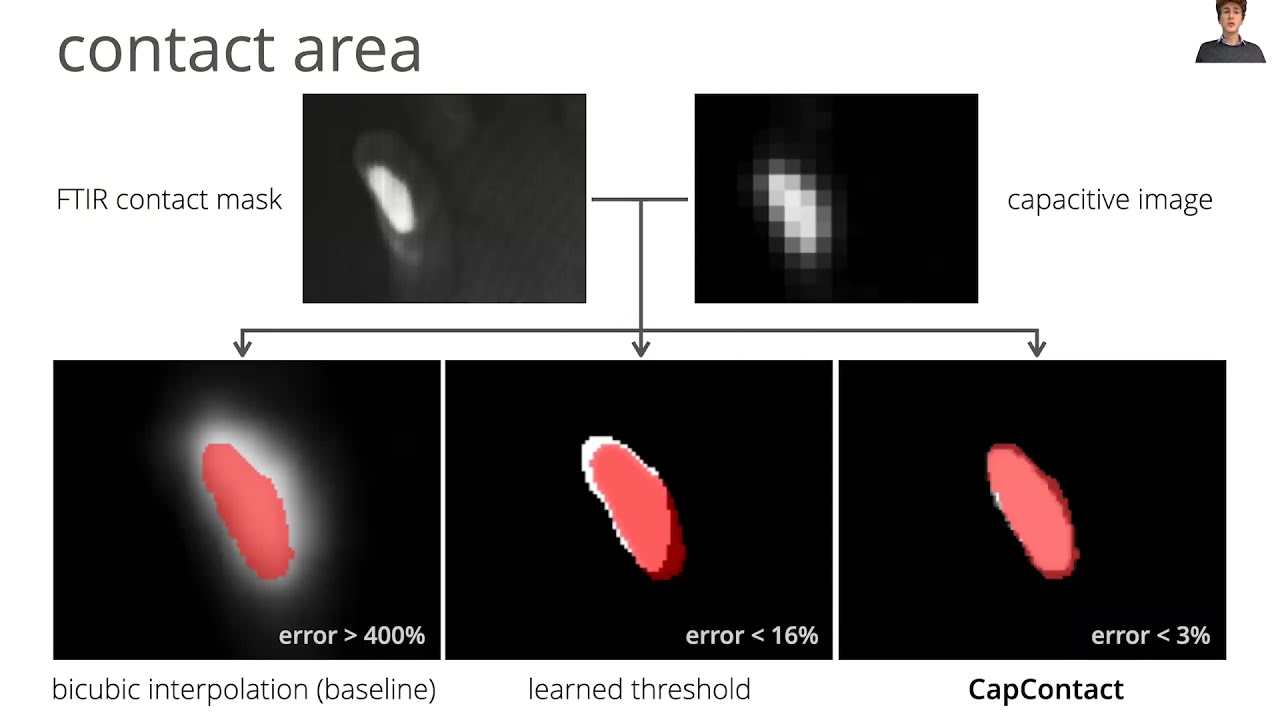

" Premièrement, 'CapContact' calcule les surfaces de contact réelles entre les doigts et les écrans tactiles lors d'un contact ", explique Holz, "deuxièmement, il calcule ces surfaces de contact avec une résolution huit fois supérieure à celle des capteurs tactiles actuels, ce qui permet à nos appareils tactiles de détecter les contacts avec beaucoup plus de précision."

Pour entra?ner l'IA, les chercheurs ont mis au point un appareil spécial qui enregistre les intensités capacitives, c'est-à-dire les quasi-contacts, et les vraies cartes de contact gr?ce à un capteur de pression à haute résolution. En enregistrant les contacts réels de nombreux participants au test, les chercheurs ont obtenu des données d'entra?nement gr?ce auxquelles "CapContact" a appris à prédire de manière super-résolue les surfaces de contact à partir des données sensorielles grossières et à faible résolution des écrans tactiles actuels.

La faible résolution, source d'erreurs

"Dans notre contribution, nous montrons qu'à partir de la surface de contact entre le doigt et l'écran du téléphone portable calculée par 'CapContact', nous pouvons déduire la position de la saisie tactile avec beaucoup plus de précision que ne le font les appareils actuels", ajoute Paul Streli. En outre, les chercheurs montrent qu'un tiers des erreurs des appareils actuels sont dues au fait que le balayage de saisie ne s'effectue qu'avec une faible résolution. "CapContact" élimine ces erreurs gr?ce à l'apprentissage automatique (deep learning).

Les chercheurs démontrent que "CapContact" reconna?t et sépare les surfaces tactiles de manière fiable, même lorsque les doigts touchent l'écran de manière très rapprochée. C'est par exemple le cas avec le geste de pincement, qui consiste à déplacer le pouce et l'index sur un écran pour agrandir des textes ou des images. Les appareils actuels peuvent à peine distinguer ce toucher. Lors d'une expérience, les chercheurs ont en outre utilisé des capteurs dont la résolution était beaucoup plus faible que ceux que l'on trouve aujourd'hui dans les téléphones portables - malgré cela, "CapContact" a mieux reconnu les contacts et a pu déduire les surfaces de contact de manière nettement plus précise que les téléphones portables avec la résolution habituelle actuelle. Il y a donc de fortes chances que cette solution d'IA soit à l'origine d'une nouvelle reconnaissance tactile pour les futurs téléphones portables et tablettes.

Afin de faciliter les travaux de suivi dans ce domaine, les chercheurs publient tous les modèles d'apprentissage profond entra?nés et les codes sources, ainsi que l'ensemble des données d'entra?nement enregistrées sur leur site web. page externePage du projet.

Référence bibliographique

Streli, P, Holz, C. CapContact : Super-resolution Contact Areas from Capacitive Touchscreens. CHI '21 : Actes de la Conférence CHI 2021 sur les facteurs humains dans les systèmes informatiques, mai 2021, Article No. : 289, Pages 1-14. DOI : page externe10.1145/3411764.3445621.